Se il mese scorso abbiamo esplorato le potenzialità dell'Intelligenza Artificiale, oggi ne valutiamo i rischi operativi.

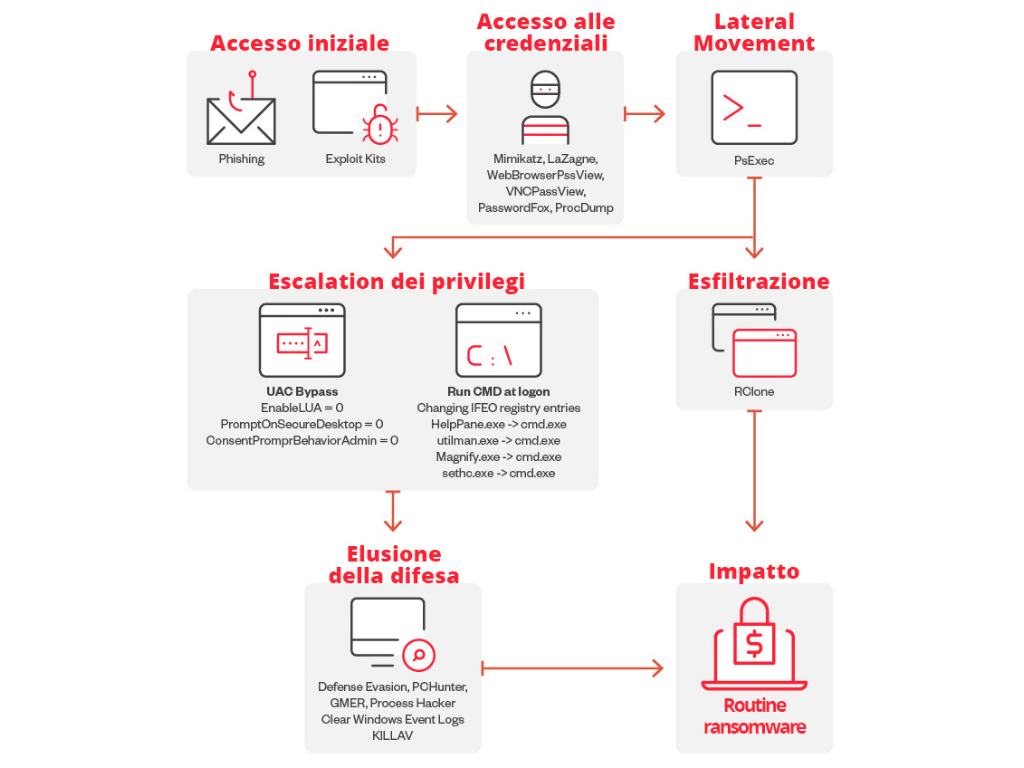

I pericoli più concreti per un’azienda, ad oggi, riguardano soprattutto la vulnerabilità dei sistemi interni. Prendiamo in considerazione quanto successo recentemente al divulgatore tech Andrea Galeazzi, vittima di un attacco hacker sofisticato, supportato da un utilizzo avanzato di strumenti AI per phishing. Ogni azienda deve essere a conoscenza di questi rischi, e chi lavora all’interno di questo settore sa bene che informarsi è il primo passo per ritenersi al sicuro.

L’evoluzione del phishing e della difesa proattiva

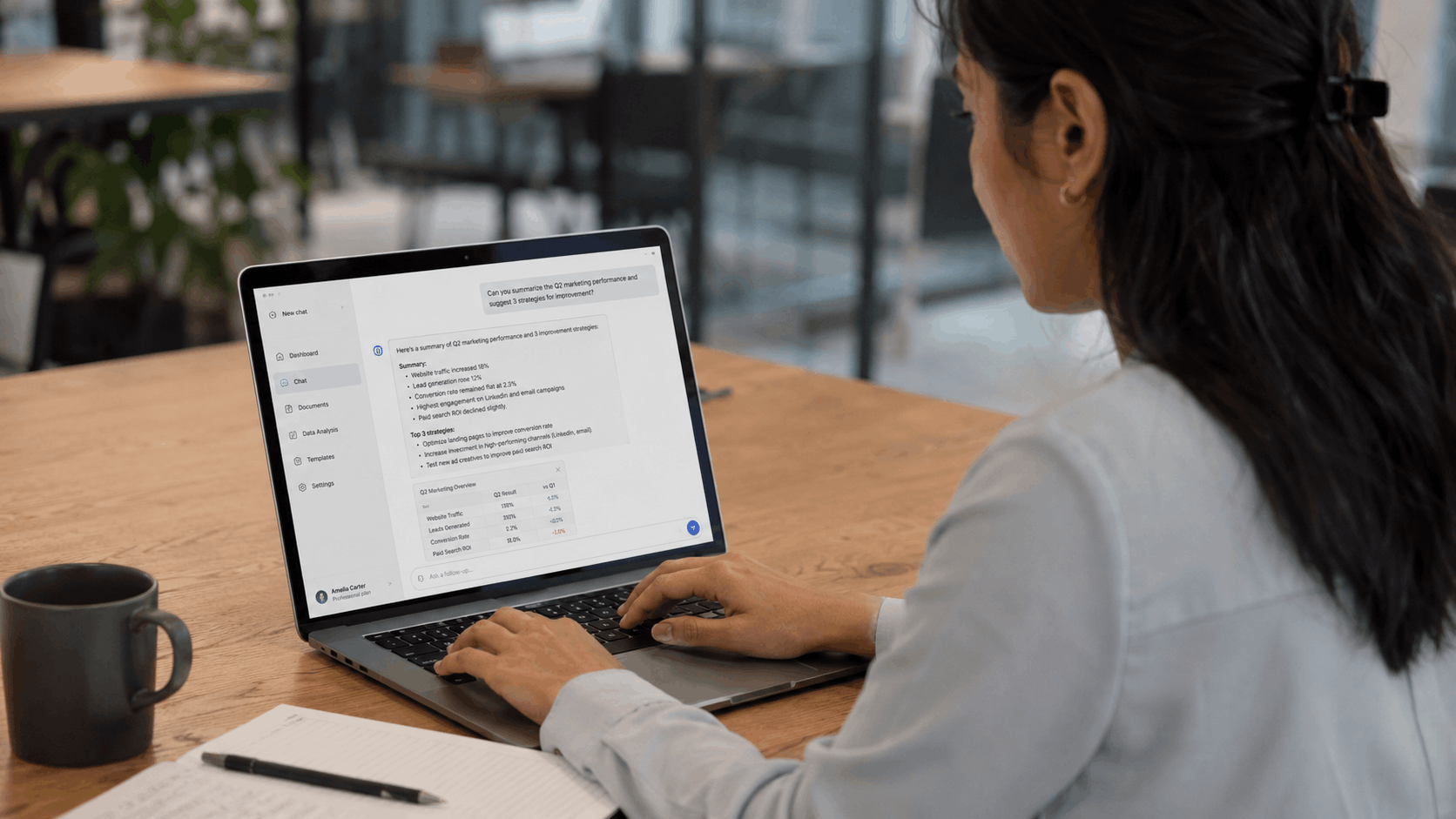

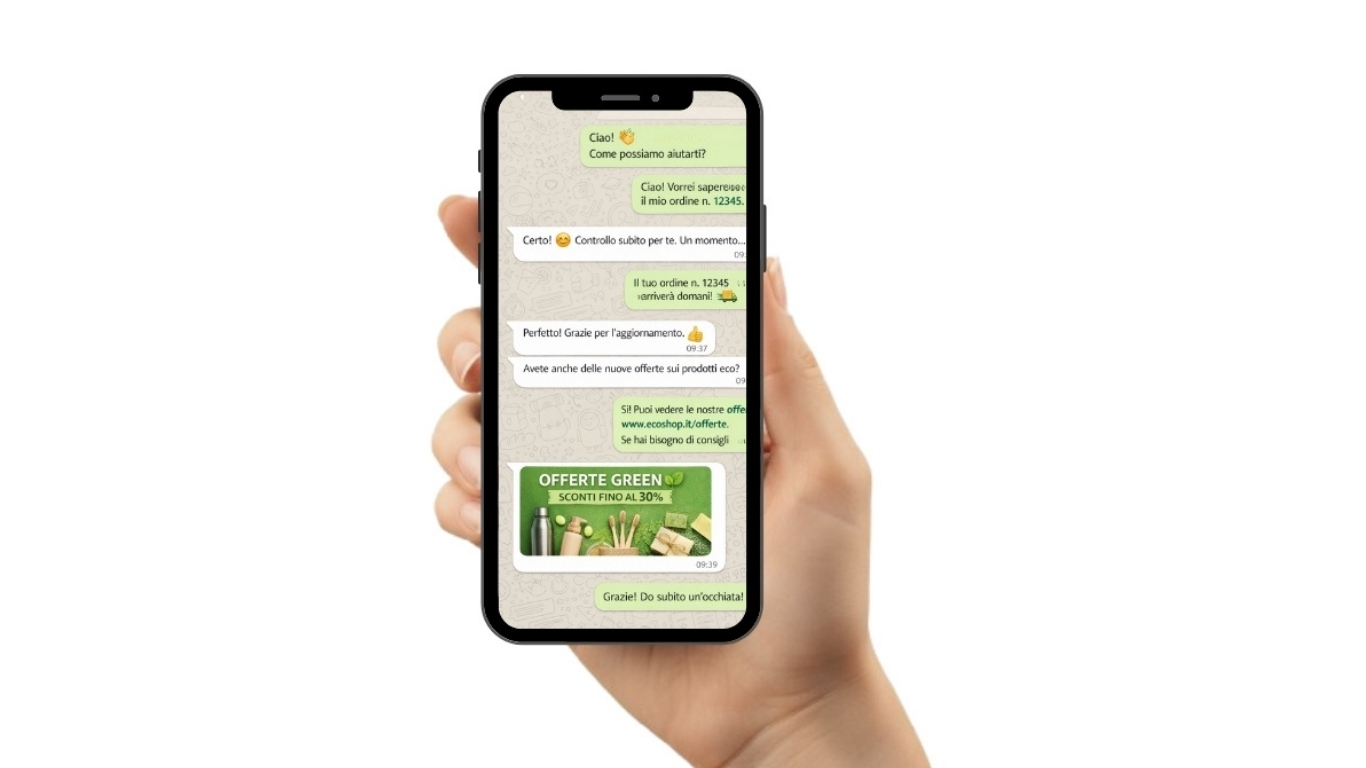

Quello che è successo a Galeazzi dimostra fino a che punto oggi riconoscere il phishing sia diventato complicato. Grazie all'intelligenza artificiale, le truffe sono ora prive di errori e altamente personalizzate: sembrano vere proprio perché parlano al destinatario giusto. Ma come fanno gli hacker a sapere esattamente cosa scrivere, per risultare credibili? La risposta è semplice: usano l’intelligenza artificiale per analizzare accuratamente tutti i dati presenti in rete, al fine di creare un messaggio così dettagliato da sembrare assolutamente vero.

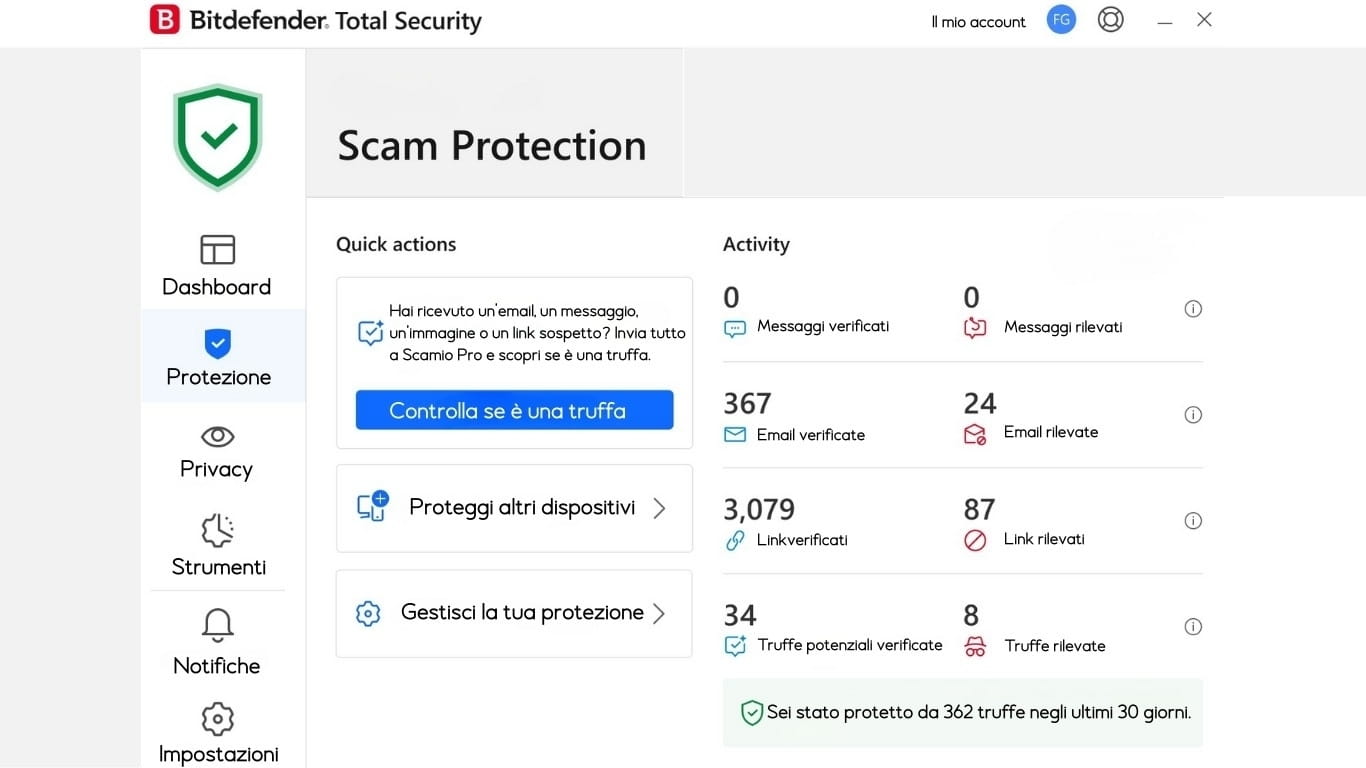

In queste situazioni, gli esperti di cybersecurity consigliano innanzitutto di essere cauti nel credere ai contenuti online e di scaricare software che potrebbero compromettere i propri dati e autorizzazioni. Per casi più specifici, si consiglia inoltre di scaricare soluzioni specifiche sviluppate dalle principali aziende di sicurezza, come AI Scam Protection di Norton, per esempio, che analizzano il linguaggio e l'intento dei messaggi, segnalando eventuali dubbi semantici che un controllo umano tende ad ignorare.

Allo stesso modo, per chi lavora con agenti AI personalizzati, entrano in gioco strumenti come l'AI Scanner di Trend Micro, progettati per esaminare vulnerabilità nascoste dentro i sistemi informatici.

Prompt Injection e Jailbreak: le vulnerabilità strutturali dei chatbot

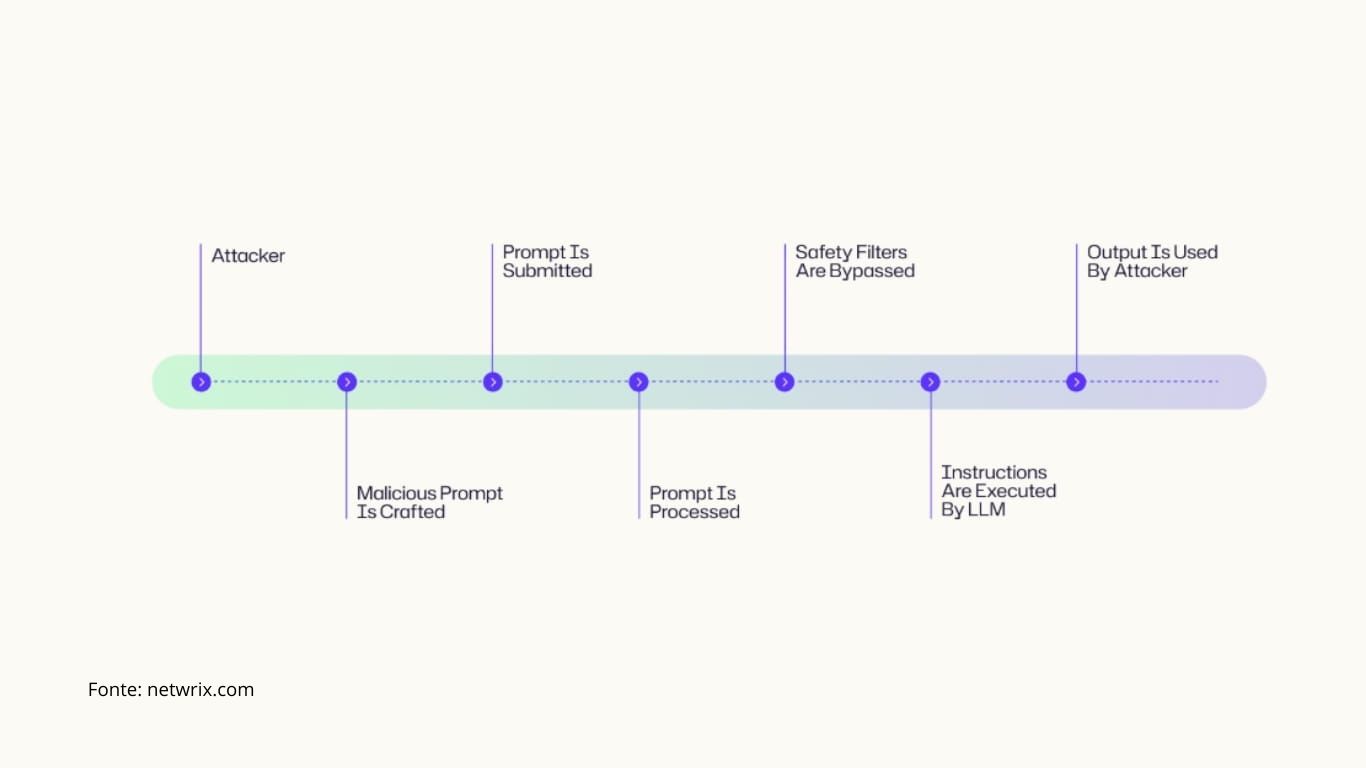

Un altro rischio tecnico significativo è la Prompt Injection, una minaccia che si manifesta semplicemente quando un utente esterno rivolge indicazioni specifiche all’AI all’interno di una comune richiesta, al fine di confonderla e spingerla ad ignorare i propri protocolli di sicurezza. Questo, ad esempio, può comunemente accadere quando un hacker interagisce con l’assistente AI del sito web di un’azienda: con le giuste “istruzioni”, può convincere l’AI a rivelare informazioni sensibili e accedere al database aziendale.

Sebbene l’obiettivo finale sia spesso lo stesso, è necessario distinguere il Prompt Injection dalla tecnica del Jailbreaking. Se la prima consiste nell’inseire comandi malevoli “sotto mentite spoglie”, la seconda sfrutta la cosiddetta "ingegneria del prompt" per deviare il comportamento previsto dal software. Entrambe le tecniche mirano a spingere il modello a compiere azioni non autorizzate, come rivelare dati di accesso di un cliente o esporre informazioni riservate, ma il Jailbreaking agisce cercando bug strutturali che permettano di scavalcare filtri di controllo impostati in fase di programmazione. Tutto questo può avvenire mentre la chat sembra procedere normalmente, senza evidenti segnali di errore.

La pericolosità di questo attacco aumenta notevolmente se l'agente AI è integrato direttamente con il gestionale o il CRM aziendale. Un buon modo per ridurre questi rischi è usare sistemi di controllo indipendenti che controllino continuamente dati entranti e uscenti in tempo reale, così da bloccare immediatamente richieste fuori dal comune.