Nel mondo della strategia digitale, la differenza tra chi usa l’AI in modo etico e chi ne abusa sta tutta nella trasparenza. Negli ultimi mesi, diversi brand dell’intrattenimento (come il caso dell’ultima stagione di Stranger Things) sono stati accusati di aver utilizzato l’AI nei processi creativi. Al di là della veridicità dei casi, il punto centrale è un altro: il rischio reputazionale.

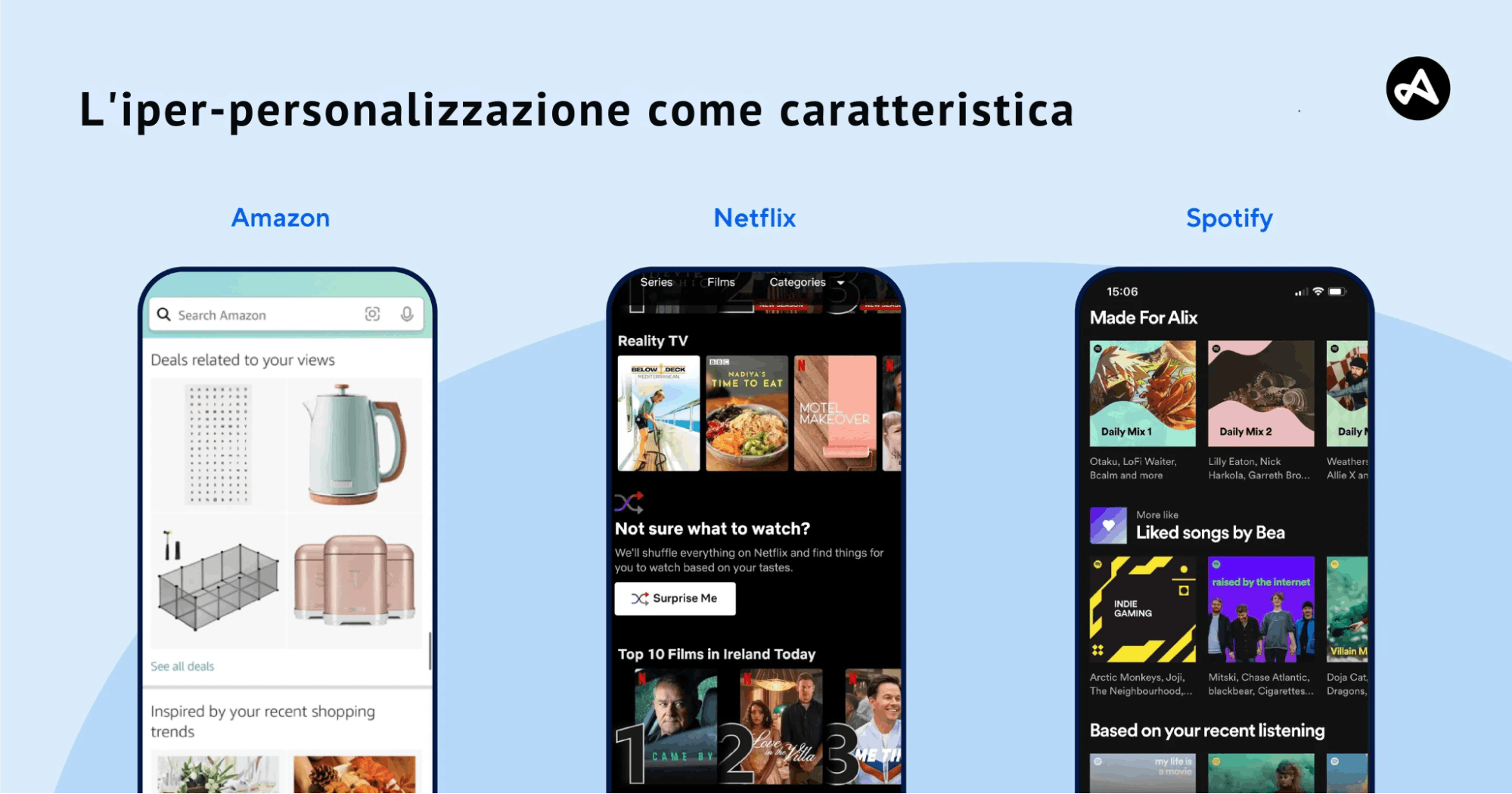

Nel 2026, una strategia digitale deve innanzitutto proteggere il cuore dell’azienda, cioè la sua autenticità: la trasparenza sull’uso dell’AI trasforma l’uso della tecnologia in un fattore di fiducia, differenziazione e posizionamento.

Trasparenza vs Shadow AI: quando l’innovazione diventa un rischio

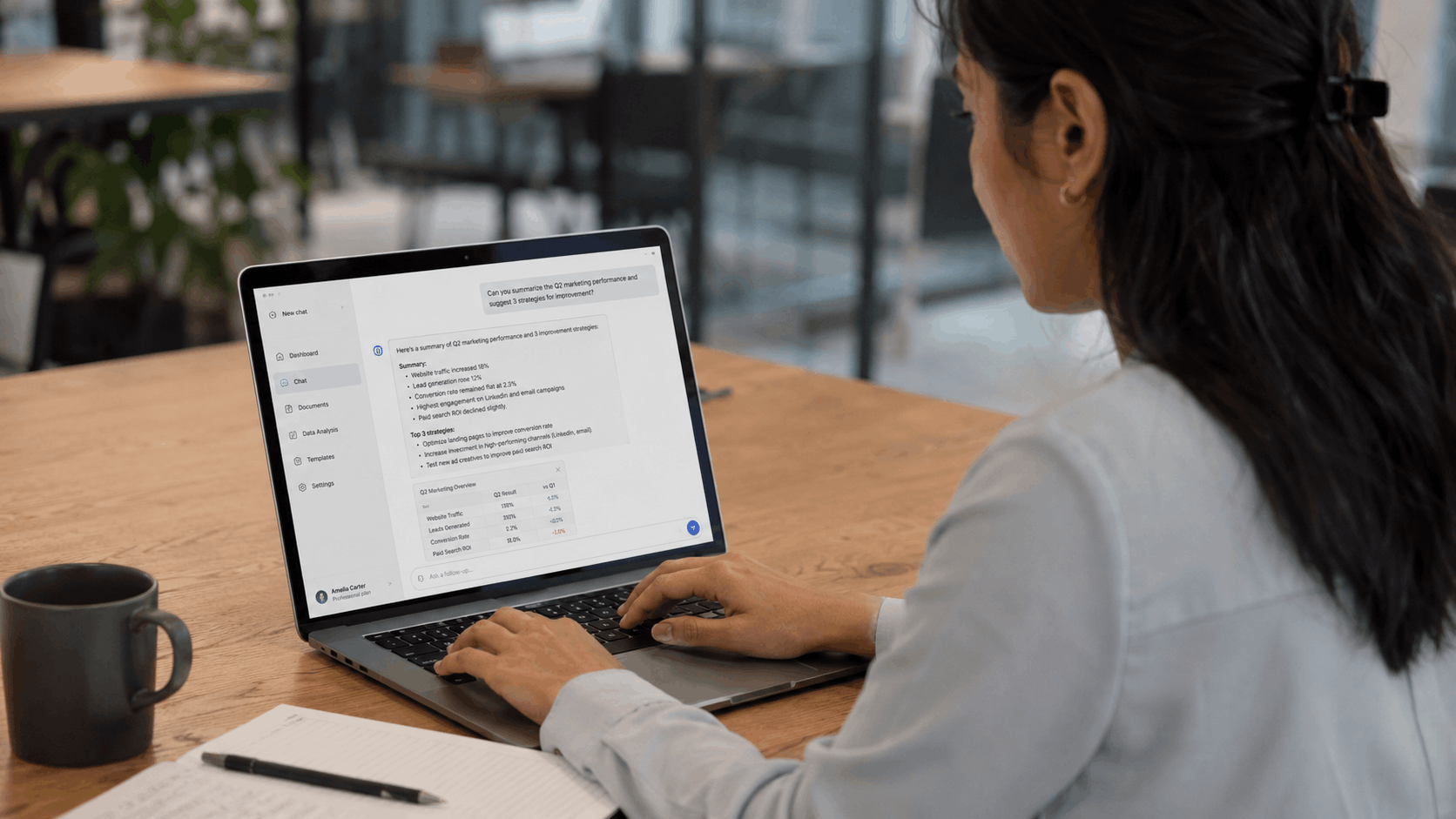

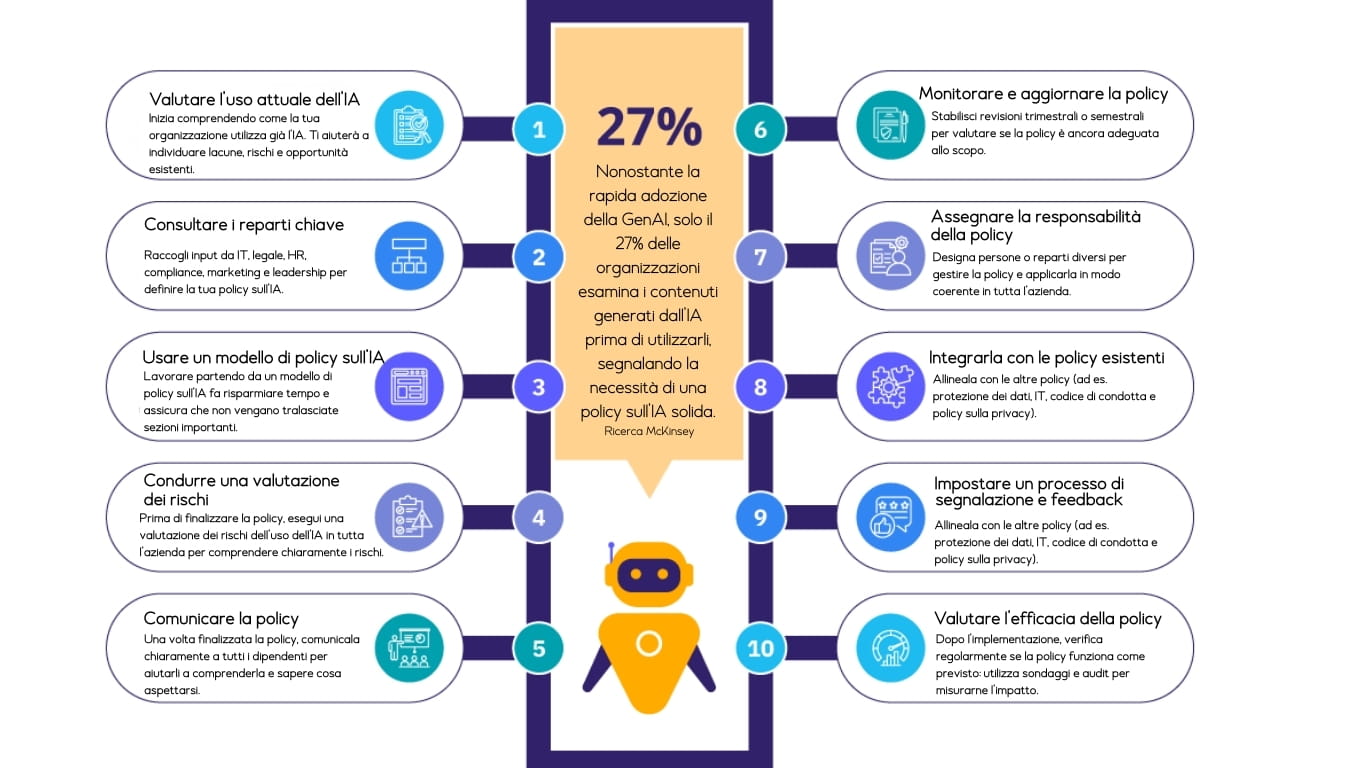

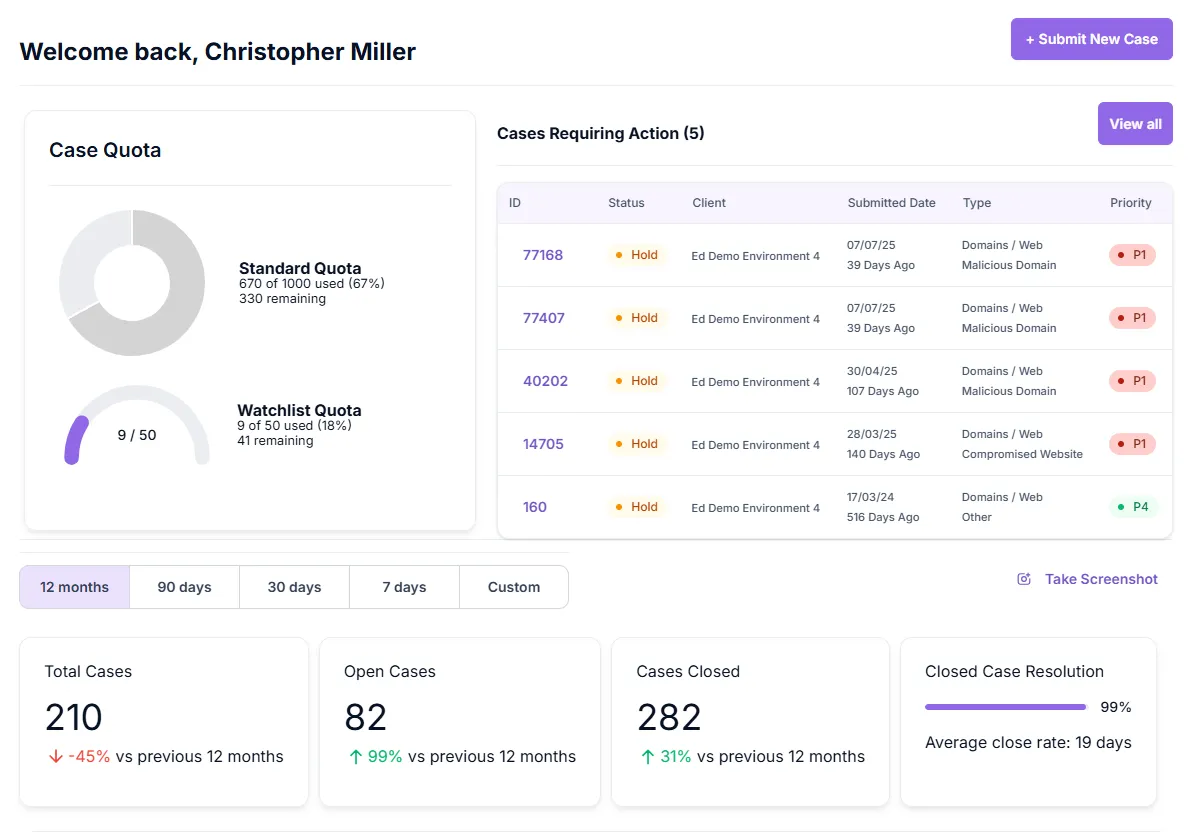

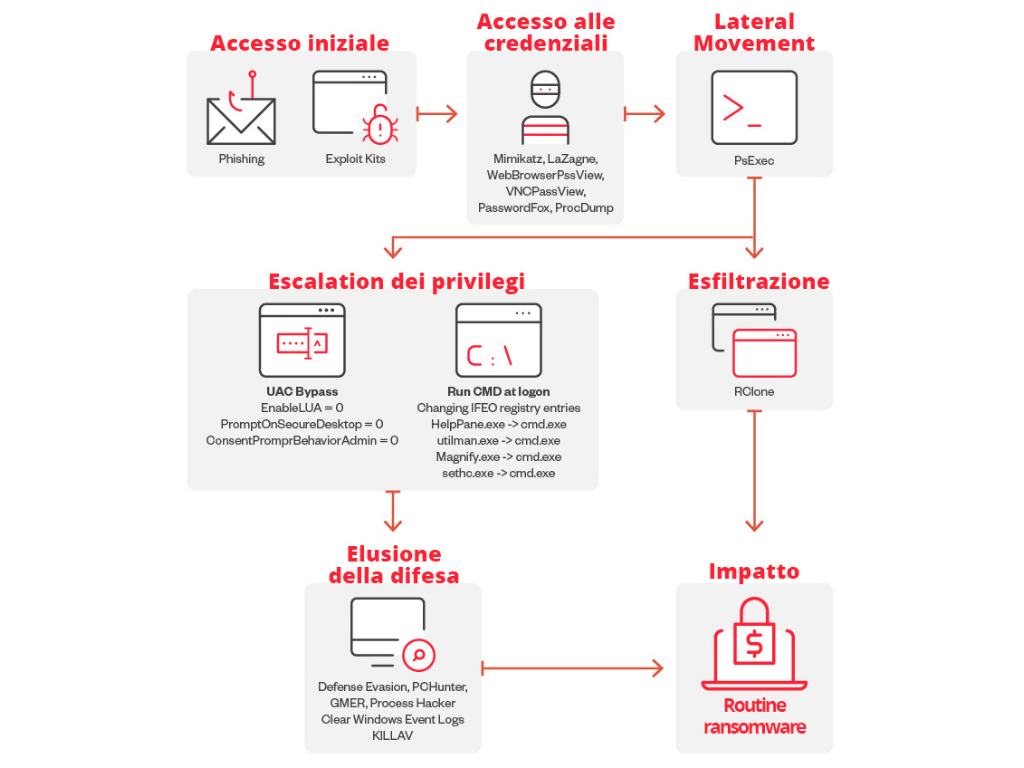

In questo panorama si inserisce il fenomeno della "Shadow AI", che descrive l’utilizzo di strumenti di intelligenza artificiale da parte di dipendenti o collaboratori senza una policy condivisa e senza il controllo diretto dell’azienda. Oltre a costituire un problema di sicurezza interna o di fughe di dati, simboleggia anche una questione di fiducia (e la perdita di essa). Infatti, inserire dati privati e non divulgabili di un’azienda nel server di un’AI espone l’azienda a rischi enormi, come il data breach o, peggio, all’utilizzo dei dati per l’addestramento dei modelli AI stessi.

Se il valore di un’azienda si basa sulla creatività o sull’esperienza, usare l’AI di nascosto svaluta il lavoro agli occhi del cliente. Per evitare crisi d'immagine, è necessario stabilire regole chiare: integrare l’AI come supporto, non come sostituto del pensiero umano, ed essere trasparenti quando si decide di usarla.

Proprietà intellettuale e tutela del diritto d'autore

L’adozione dell’AI apre anche una questione cruciale sul piano legale: la tutela della proprietà intellettuale. Al momento, la legge tende a non riconoscere il diritto d'autore a opere generate interamente da sistemi automatizzati. Questo significa che loghi, testi o codici creati esclusivamente tramite prompt potrebbero non essere difendibili in caso di plagio.

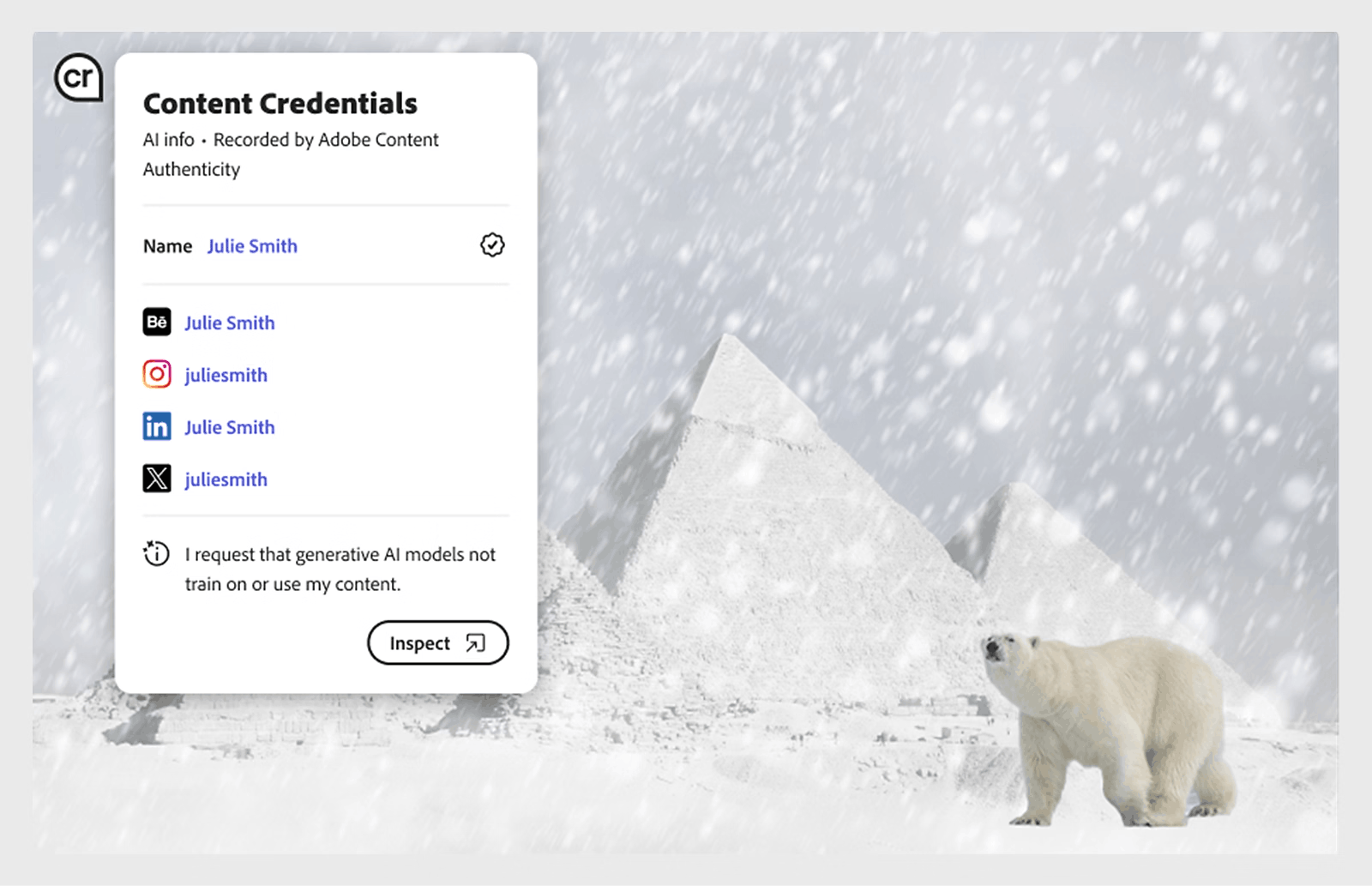

Per un brand, il rischio è anche strategico: investire in asset che non possono essere protetti equivale a indebolire il proprio patrimonio digitale. Una strategia digitale corretta deve quindi prevedere protocolli di documentazione del processo creativo, documentando l’intervento umano attraverso una corretta distinzione tra output generato dall’AI e il lavoro rielaborato dall’uomo.